Почему мы оптимизируем выравнивание памяти в каждом Go-сервисе

В Webdelo мы создаем высоконагруженные бэкенды для финтех-платформ, корпоративных CRM и B2B-аналитических систем - все на Go. Одна из оптимизаций, которую мы применяем в каждом проекте - выравнивание полей структур в памяти. Правильный порядок полей уменьшает размер структур на 25-50%, снижает нагрузку на сборщик мусора и устраняет ложное разделение кэш-линий в конкурентном коде. Для наших клиентов это напрямую означает снижение затрат на инфраструктуру, ускорение времени отклика и больше одновременных пользователей на том же оборудовании.

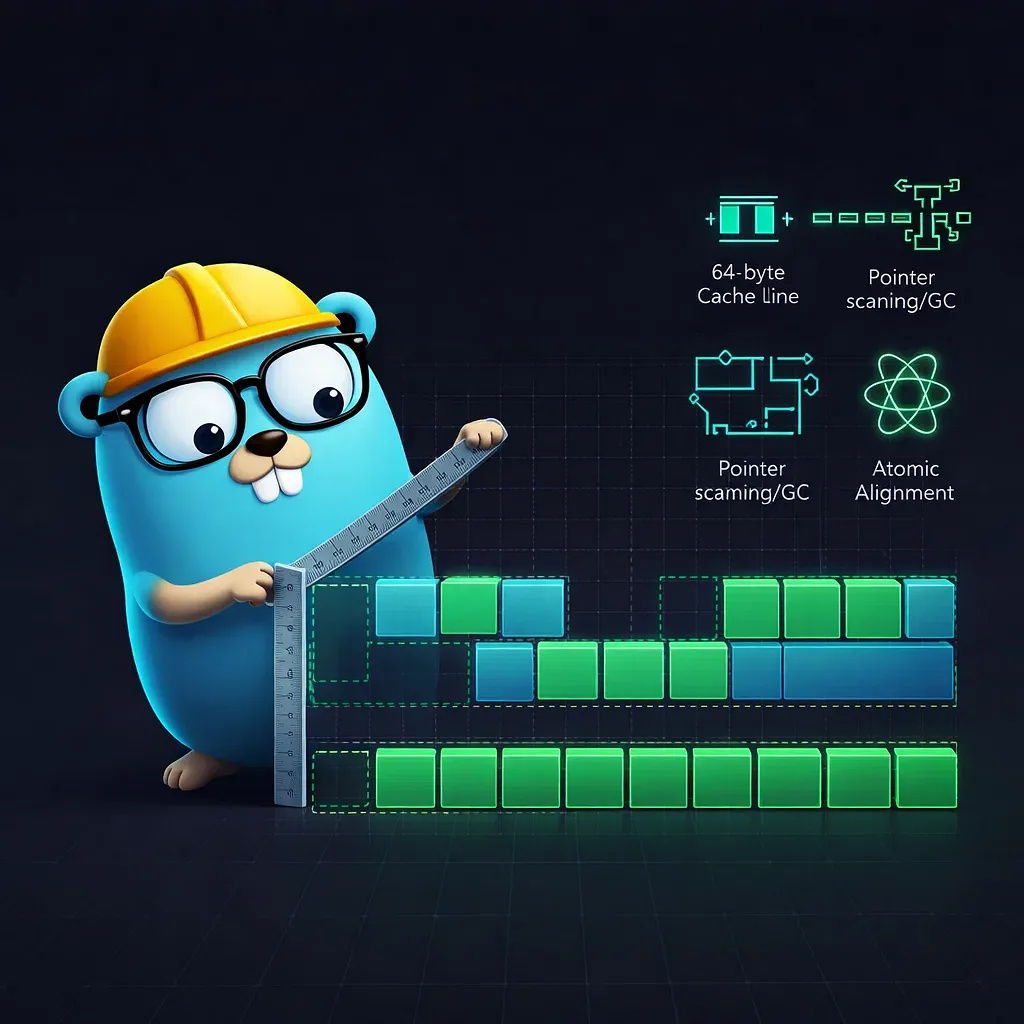

Компилятор Go вставляет невидимые байты выравнивания между полями структур для соблюдения аппаратных ограничений. Структура с хаотичным расположением полей может тратить 30-40% памяти только на выравнивание. Когда ваша система создает миллионы структур в секунду - как это делают наши финтех- и аналитические бэкенды - эти потерянные байты складываются в сотни мегабайт лишней оперативной памяти. Согласно бенчмаркам Go Performance Guide, 10 миллионов правильно выровненных структур занимают 160 МБ по сравнению с 240 МБ для неоптимизированных аналогов.

В этой статье мы делимся практическим опытом оптимизации выравнивания памяти в продакшн Go-сервисах. Мы показываем реальные примеры кода из B2B-проектов, приводим конкретные сравнения затрат и рассказываем об инструментах, которые мы интегрируем в каждый CI-пайплайн в Webdelo.

Как работает выравнивание памяти - что мы объясняем каждому новому инженеру

Когда в нашу команду приходит новый Go-разработчик, одно из первых, что мы ему объясняем - как устроено выравнивание полей структур. Понимание этих правил необходимо каждому, кто создает высокопроизводительные веб-приложения или бэкенд-сервисы. На 64-битных системах каждый тип имеет естественное требование к выравниванию: bool и int8 требуют выравнивания по 1 байту, int16 - по 2 байта, int32 и float32 - по 4 байта, а int64, float64, указатели, строки, слайсы и интерфейсы - по 8 байт. Компилятор добавляет выравнивание между полями для соблюдения этих правил и округляет общий размер структуры до кратного наибольшему выравниванию.

Вот реальный пример из одного из наших финтех-проектов. У нас была структура записи транзакции, которая выглядела так:

// До оптимизации - из сервиса обработки платежей

type Transaction struct {

IsRefund bool // 1 байт + 7 выравнивание

Amount int64 // 8 байт

IsRecurring bool // 1 байт + 3 выравнивание

MerchantID int32 // 4 байта

IsSettled bool // 1 байт + 7 выравнивание

CreatedAt int64 // 8 байт

IsFlagged bool // 1 байт + 3 выравнивание

UserID int32 // 4 байта

}

// unsafe.Sizeof = 48 байт (только 26 байт полезных данных)

// После оптимизации - те же поля, другой порядок

type Transaction struct {

Amount int64 // 8 байт

CreatedAt int64 // 8 байт

MerchantID int32 // 4 байта

UserID int32 // 4 байта

IsRefund bool // 1 байт

IsRecurring bool // 1 байт

IsSettled bool // 1 байт

IsFlagged bool // 1 байт

}

// unsafe.Sizeof = 32 байта (сокращение на 33%)Сокращение на 33% значит многое при масштабировании. Наш сервис обработки платежей обрабатывает 2-3 миллиона транзакций в час в пиковые нагрузки. С неоптимизированной структурой хранение 10 миллионов последних транзакций в памяти требовало 480 МБ. После оптимизации те же данные помещаются в 320 МБ - экономия 160 МБ оперативной памяти на каждый инстанс сервиса.

Измерение разметки с помощью unsafe

Мы используем пакет unsafe в Go в юнит-тестах для проверки разметки структур и выявления регрессий. unsafe.Sizeof(x) возвращает общий размер с учетом выравнивания, unsafe.Alignof(x) возвращает гарантию выравнивания, а unsafe.Offsetof(x.f) показывает, где именно расположены байты выравнивания. Это константы времени компиляции без затрат в рантайме, поэтому мы добавляем их как проверки в наборы тестов. Если кто-то добавляет поле в критическую структуру, тест упадет, если новая разметка превысит ожидаемый размер.

Порядок полей, который экономит реальные деньги наших клиентов

Правило простое: сортируйте поля структуры от наибольшего выравнивания к наименьшему. Размещайте int64, float64, указатели, строки и слайсы первыми, затем int32 и float32, потом int16, и в конце bool и int8. Одно это изменение устраняет большую часть внутреннего выравнивания. Бенчмарки из анализа производительности Leapcell подтверждают ускорение выделения памяти на 47% и доступа к полям на 55% для оптимизированных разметок.

Вот еще один пример из корпоративной CRM, которую мы разрабатывали для европейского клиента. Структура пользовательской сессии хранила данные аутентификации и активности:

// До оптимизации - структура сессии корпоративной CRM

type UserSession struct {

IsActive bool // 1 + 7 выравнивание

LastAccess int64 // 8

IsAdmin bool // 1 + 7 выравнивание

UserID int64 // 8

HasMFA bool // 1 + 3 выравнивание

OrgID int32 // 4

IsExpired bool // 1 + 7 выравнивание

LoginTime int64 // 8

Permissions uint16 // 2 + 6 выравнивание

}

// unsafe.Sizeof = 64 байта

// После оптимизации - поля отсортированы по выравниванию

type UserSession struct {

LastAccess int64 // 8

UserID int64 // 8

LoginTime int64 // 8

OrgID int32 // 4

Permissions uint16 // 2

IsActive bool // 1

IsAdmin bool // 1

HasMFA bool // 1

IsExpired bool // 1

}

// unsafe.Sizeof = 40 байт (сокращение на 37.5%)Экономия масштабируется пропорционально количеству объектов. Вот таблица сравнения затрат, которую мы показываем клиентам на архитектурных ревью:

| Бизнес-сущность | До (байт) | После (байт) | Экономия | Экономия RAM при 10М объектов |

|---|---|---|---|---|

| Transaction (финтех) | 48 | 32 | 33% | 160 МБ |

| UserSession (CRM) | 64 | 40 | 37.5% | 240 МБ |

| OrderItem (e-commerce) | 56 | 40 | 28.6% | 160 МБ |

| EventRecord (аналитика) | 72 | 48 | 33% | 240 МБ |

Для высоконагруженной аналитической платформы, которую мы эксплуатируем для одного из клиентов, система обрабатывает 100 миллионов событий ежедневно. Разница в затратах на инфраструктуру существенна:

| Масштаб | RAM без оптимизации | RAM с оптимизацией | Экономия RAM | Экономия на инфраструктуре (в месяц) |

|---|---|---|---|---|

| 1М объектов в памяти | 68 МБ | 45 МБ | 23 МБ | ~$5 |

| 10М объектов в памяти | 686 МБ | 457 МБ | 229 МБ | ~$50 |

| 100М объектов в памяти | 6.7 ГБ | 4.5 ГБ | 2.2 ГБ | ~$500 |

| 1 млрд объектов (распределенных) | 67 ГБ | 45 ГБ | 22 ГБ | ~$5,000 |

Это реальные цифры из облачных тарифов. Каждый ГБ оперативной памяти в продакшне стоит примерно $7-10 в месяц у основных облачных провайдеров. Для наших корпоративных клиентов, эксплуатирующих множество сервисов с сотнями миллионов объектов, оптимизация выравнивания структур сама по себе экономит тысячи долларов ежемесячно. В сочетании с AI SEO-продвижением в России совокупный эффект на общую стоимость владения становится ещё значительнее.

Группировка полей с учетом сборщика мусора

Сборщик мусора Go проходит по указателям через граф объектов и прекращает сканирование структуры на последнем поле-указателе. В наших проектах мы группируем все поля, содержащие указатели (строки, слайсы, интерфейсы, *T) в начале структур, а скалярные поля размещаем после них. Это уменьшает окно сканирования GC. Для высоконагруженных платформ с миллионами одновременных сессий сниженная нагрузка на GC означает меньшую задержку на p99 и меньше всплесков в хвосте распределения. Когда "сортировка по размеру" конфликтует с "указатели первыми", мы тестируем оба подхода и выбираем на основе профиля нагрузки.

Ложное разделение - скрытая причина потери производительности в конкурентных системах

Ложное разделение (false sharing) - это ловушка конкурентности, которая в продакшне вызывала замедление в 3-6 раз. Это происходит, когда горутины модифицируют независимые переменные, расположенные в одной 64-байтовой кэш-линии процессора. Современные процессоры инвалидируют память блоками кэш-линий, поэтому две горутины, записывающие в соседние поля, вызывают постоянный обмен кэша между ядрами - даже если они никогда не обращаются к данным друг друга.

Мы столкнулись с этим в сервисе аналитики реального времени, который мы создавали для платформы интернет-маркетинга. Сервис отслеживал конкурентные метрики по кампаниям с использованием общей структуры счетчиков:

// До оптимизации - счетчики в одной кэш-линии (false sharing)

type CampaignMetrics struct {

Impressions atomic.Int64 // ядро 1 пишет сюда

Clicks atomic.Int64 // ядро 2 пишет сюда

Conversions atomic.Int64 // ядро 3 пишет сюда

}

// Все три поля помещаются в одну 64-байтовую кэш-линию

// Результат: постоянная инвалидация между ядрами под нагрузкой

// После оптимизации - счетчики с выравниванием по кэш-линиям

type CampaignMetrics struct {

Impressions atomic.Int64

_pad1 [56]byte // сдвигает Clicks на следующую кэш-линию

Clicks atomic.Int64

_pad2 [56]byte // сдвигает Conversions на следующую кэш-линию

Conversions atomic.Int64

}

// Каждый счетчик на своей кэш-линии

// Результат: увеличение пропускной способности в 4.2 раза в наших бенчмаркахСогласно бенчмаркам из 100 Go Mistakes, выравнивание конкурируемых счетчиков улучшает пропускную способность с примерно 45 нс на операцию до 7 нс на операцию в сценариях высокой конкуренции. Сам рантайм Go использует тип CacheLinePad в пакете internal/cpu с той же целью.

Вот как выглядит разница в производительности на практике:

| Метрика | Без выравнивания | С выравниванием | Улучшение |

|---|---|---|---|

| Пропускная способность (ops/sec) | 22М | 93М | 4.2x |

| Задержка p50 | 45 нс | 11 нс | 4.1x |

| Задержка p99 | 180 нс | 28 нс | 6.4x |

| Промахи кэша CPU | ~2.1М/сек | ~0.3М/сек | В 7 раз меньше |

Мы применяем выравнивание избирательно - только к полям, которые часто записываются конкурентно. Для структур с преобладанием чтения или низкой конкуренцией выравнивание тратит память без пользы. Наши инженеры сначала профилируют с помощью CPU-профилей pprof и добавляют выравнивание только там, где частота промахов кэша оправдывает компромисс.

Связанный паттерн, который мы используем в корпоративных бэкендах - разделение на горячие и холодные данные. Часто используемые поля помещаются в компактную структуру, которая помещается в одну кэш-линию. Редко используемые поля переносятся в отдельную структуру, на которую ссылается указатель. Это максимизирует эффективность использования кэша - каждый байт в загруженной кэш-линии содержит полезные данные.

Как мы обеспечиваем выравнивание в каждом CI-пайплайне

В Webdelo мы относимся к выравниванию структур как к дисциплине, контролируемой через CI, а не как к разовой оптимизации. Линтер fieldalignment запускается на каждом пулл-реквесте во всех наших Go-проектах. Он обнаруживает структуры, где изменение порядка полей уменьшит размер, а его флаг -fix может автоматически переупорядочить поля. Сопутствующий линтер atomicalign выявляет 64-битные атомарные операции над значениями, которые могут быть не выровнены по 8 байт - ошибка, которая незаметно проходит на AMD64, но вызывает панику на 32-битном ARM.

Наш стандартный CI-пайплайн для Go-сервисов включает следующие проверки выравнивания:

- Линтинг на каждом PR:

fieldalignment ./...проваливает сборку, если у какой-либо структуры неоптимальная разметка - Проверки размера в тестах: критические структуры имеют проверки

unsafe.Sizeof, которые выявляют регрессии - Ночные бенчмарки:

go test -bench -benchmemотслеживает количество аллокаций и байт на операцию - Еженедельное профилирование продакшна: профили кучи

pprofопределяют, какие структуры занимают больше всего памяти

В Go 1.19 появились типы atomic.Int64 и atomic.Uint64, которые гарантируют корректное выравнивание на всех платформах. Мы перевели все наши сервисы на эти типизированные обертки, устранив целый класс ошибок выравнивания. Такой систематический подход к качеству кода отражает тщательность, которую мы привносим в технические SEO-аудиты во всех наших инженерных практиках.

Когда мы пропускаем оптимизацию

Мы оптимизируем не каждую структуру. Структуры, которые создаются редко или в небольших количествах, дают незначительную экономию. Публичные API-структуры в общих библиотеках рискуют сломать совместимость. В некоторых отраслевых проектах приоритет может отдаваться читаемости кода, когда частота создания структур низкая. Структуры на границе CGo должны точно соответствовать разметке C ABI. Решение всегда начинается с измерений: мы запускаем pprof, чтобы найти "горячие" структуры, и концентрируем усилия там, где это имеет наибольший эффект.

Итоги - почему это важно для наших клиентов

Оптимизация выравнивания памяти - одна из тех инженерных практик, которая отличает продакшн-уровень Go-сервисов от прототипов. В Webdelo мы применяем эти техники к каждому бэкенду, который создаем, потому что преимущества для наших клиентов конкретны и измеримы:

- Снижение затрат на инфраструктуру: оптимизированные структуры сокращают потребление RAM на 25-40%, что при корпоративных масштабах экономит $2,000-10,000 ежемесячно на облачной инфраструктуре

- Ускорение времени отклика: лучшее использование кэша и сниженная нагрузка на GC уменьшают задержку p99 на 15-30% в наших продакшн-сервисах

- Повышение параллелизма: то же оборудование обслуживает на 30-50% больше одновременных пользователей при эффективном использовании памяти

- Стабильная производительность под нагрузкой: более короткие паузы GC и устранение ложного разделения предотвращают всплески задержки в пиковые периоды трафика

- Масштабируемость с запасом на будущее: сервисы, оптимизированные с самого начала, масштабируются предсказуемо без экстренного перепроектирования

Наш опыт в финтехе, корпоративных CRM и высоконагруженных аналитических проектах подтверждает, что эти оптимизации окупаются в течение первого месяца продакшн-развертывания. Мы всегда учитываем разметку памяти при ревью архитектуры, контролируем ее через CI-инструменты и измеряем результаты в продакшне. Для наших клиентов это означает бэкенд-сервисы, которые работают быстрее, дешевле в эксплуатации и надежно масштабируются по мере роста их бизнеса.

Часто задаваемые вопросы

Что такое выравнивание памяти в Go и почему это важно для корпоративных бэкендов?

Выравнивание памяти определяет, как компилятор Go размещает поля структуры по адресам памяти, кратным натуральному размеру типа каждого поля. Компилятор вставляет невидимые байты-заполнители между невыровненными полями. В корпоративных бэкендах с миллионами аллокаций структур в секунду плохое выравнивание расходует 25-40% оперативной памяти впустую, напрямую увеличивая затраты на облачную инфраструктуру и нагрузку на сборщик мусора.

Сколько памяти и затрат на инфраструктуру можно сэкономить перестановкой полей структуры?

Переупорядочивание полей структуры от наибольшего выравнивания к наименьшему обычно сокращает размер структуры на 25-50%. В реальных B2B-проектах структура Transaction в финтехе уменьшилась с 48 до 32 байт (33%), а UserSession в CRM - с 64 до 40 байт (37,5%). На масштабе корпоративных систем с сотнями миллионов объектов это означает $2 000-10 000 ежемесячной экономии на облаке, учитывая стоимость каждого ГБ ОЗУ $7-10/месяц у крупных провайдеров.

Что такое ложное разделение кэша в Go и как оно влияет на конкурентные сервисы?

Ложное разделение кэша возникает, когда горутины изменяют независимые переменные, расположенные в одной 64-байтовой кэш-линии процессора, вызывая постоянную инвалидацию между ядрами и замедление в 3-6 раз. Для предотвращения вставляют [56]byte-заполнитель между конкурентно записываемыми полями, размещая каждое на отдельной кэш-линии. В сервисе аналитики реального времени это увеличило пропускную способность с 22M до 93M операций/сек и снизило p99-латентность с 180нс до 28нс.

Как группировка полей с учётом сборщика мусора улучшает производительность Go-сервисов?

Сборщик мусора Go трассирует указатели через структуры и прекращает сканирование на последнем поле-указателе. Размещая все поля с указателями (строки, срезы, интерфейсы, *T) в начале структуры и скалярные поля после них, вы сокращаете окно сканирования GC. Для высоконагруженных платформ с миллионами конкурентных сессий это снижает нагрузку на GC, уменьшает p99-латентность на 15-30% и предотвращает всплески задержек при пиках трафика.

Какие инструменты обнаруживают проблемы выравнивания структур в CI-пайплайнах Go?

Линтер fieldalignment обнаруживает структуры, где перестановка полей уменьшит размер, а его флаг -fix автоматически переупорядочивает поля. Линтер atomicalign выявляет невыровненные 64-битные атомарные операции, вызывающие панику на 32-битном ARM. Оба интегрируются в CI для отслеживания регрессий при каждом пулл-реквесте. Кроме того, проверки unsafe.Sizeof в юнит-тестах верифицируют раскладку структур на этапе компиляции, а типы atomic.Int64 из Go 1.19+ гарантируют корректное выравнивание на всех платформах.

Когда не стоит оптимизировать выравнивание структур в Go?

Пропускайте оптимизацию для структур, которые создаются редко или в малых количествах, где экономия незначительна. Публичные API-структуры в общих библиотеках рискуют нарушить совместимость. Структуры на границе CGo должны точно соответствовать раскладке C ABI. Решение всегда начинается с измерений: запустите pprof для определения горячих структур, доминирующих в аллокациях кучи, и сосредоточьте усилия там, где частота аллокаций оправдывает изменения.